Johnson & Johnson、AIで創薬候補探索時間を半減

Reutersによると、Johnson & JohnsonはAI活用によって、新薬候補探索に要する期間を半減できたと報告しました。

同社では、化合物スクリーニング、生物製剤候補探索、臨床試験文書作成、製造工程最適化など、多数の工程でAIを活用しているとされています。

創薬では、膨大な候補分子から有望なリード化合物を絞り込む作業に多大な時間とコストが必要になります。

AIは、過去データや構造情報をもとに候補探索を高速化し、仮説生成や最適化を支援する役割を担っています。 Johnson & Johnsonの事例は、AIが研究開発プロセスの効率化に実際の成果を出し始めていることを示しています。

一方で、AI単独で新薬を発見し、市販化まで完結できる段階には至っていません。

安全性、有効性、再現性の検証には依然として人間研究者や臨床試験が不可欠です。

今後は、AIを「研究者の代替」とみなすのではなく、「研究開発を加速する共同パートナー」として位置づける方向性が現実的と考えられます。

Mayo Clinic、AIで膵臓がんを早期検出

Mayo Clinicは、AIモデル「REDMOD」により、膵臓がんを臨床診断より最大3年前に検出できる可能性を報告しました。

膵臓がんは早期発見が難しく、診断時には進行しているケースが多いことから、今回の研究は大きな注目を集めています。

REDMODは、通常の腹部CT画像から早期の画像特徴を抽出し、中央値約16か月前に診断前がんを識別できたとされています。

研究では、診断前症例の73%を検出し、専門医読影を上回る感度を示しました。

ただし、現時点では研究段階であり、実臨床での運用には追加の前向き試験が必要とされています。

特に、高リスク患者群における有効性検証や、偽陽性への対応が重要になると考えられます。

AI画像診断は、医師を代替するものではなく、見落とし低減やスクリーニング補助として活用される方向性が現実的といえるでしょう。

日本でもAI・データ活用を後押しする制度整備

日本では、AI開発とデータ利活用を促進する制度整備が進みつつあります。

2026年4月には個人情報保護法改正案が提出され、一定条件下では本人同意なしで統計情報作成やAI開発にデータを利用可能とする規定が盛り込まれました。

また、日本版AI法では、AI研究開発や活用推進を進めつつ、事業者による自主的ガバナンスを重視する方針が示されています。

EU AI Actのような強い規制中心型とは異なり、日本では柔軟な利活用を重視する方向性が特徴です。

一方で、医療AIや研究データ活用では、個人情報保護法だけでなく、医学系研究倫理指針、次世代医療基盤法、施設内規程などを横断的に確認する必要があります。

AI活用の推進と患者データ保護をどのように両立させるかが、今後の重要テーマになると考えられます。

参考:参議院 法律案情報

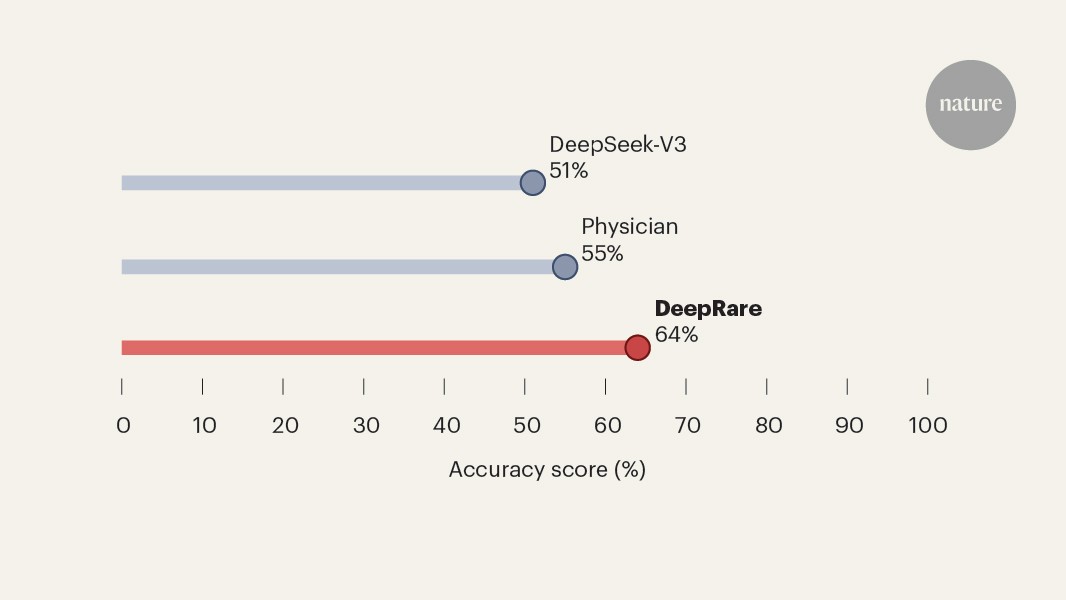

DeepRare、希少疾患診断支援AIとして注目

希少疾患診断支援AI「DeepRare」が、NatureのNews & Viewsで紹介されました。

希少疾患は種類が非常に多く、経験豊富な医師でも診断候補を迅速に想起することが難しい領域です。

DeepRareは、症状、HPO表現型、遺伝学的検査結果などを統合し、複数の専門ツールや知識ソースを利用して診断候補を提示するマルチエージェント型システムです。

比較試験では、専門医平均を上回る診断性能が報告されています。

一方で、一部の参考文献やURLに不正確な参照が含まれる可能性も指摘されており、AI出力をそのまま診断に用いる危険性も示唆されています。

そのため、DeepRareのようなシステムは、医師を代替するものではなく、膨大な医学知識を整理し、鑑別診断を広げる支援ツールとして位置づけることが重要です。

参考:Nature記事

製薬業界で加速するAI統合

製薬業界では、生成AIを全社的に統合する動きが加速しています。

Novo NordiskはOpenAIとの戦略提携を発表し、創薬、製造、サプライチェーン、商業部門へAIを導入する方針を示しました。 またJohnson & Johnsonも、AIによって創薬候補探索期間を半減できたと報告しています。

AIは、化合物探索、仮説生成、臨床試験文書作成、製造工程最適化など、創薬プロセス全体で活用され始めています。

単なる研究支援ツールではなく、製薬企業の基幹業務を支える基盤技術として位置づけられつつあります。

ただし、AIが単独で新薬を発見し上市まで進める段階には至っておらず、人間研究者による検証と意思決定は依然として不可欠です。

今後は、説明可能性、再現性、規制対応などを含めた実装体制が重要になると考えられます。

AWS、EHR統合型AI「Amazon Connect Health」を発表

AWSは、医療機関向けAIサービス「Amazon Connect Health」を発表しました。

本サービスは、患者確認、診療要約、SOAPノート生成、医療コーディング支援などを、EHRワークフロー内で提供することを目的としています。

Epicを含む主要EHRとの連携が想定されており、診察中の会話からリアルタイムに診療記録を生成するアンビエント・ドキュメンテーション機能も特徴です。

AWSは、「別アプリとしてのAI」ではなく、「既存ワークフローへ埋め込まれるAI」を目指している点を強調しています。

ただし、AWSは本サービスを医療機器ではないと明記しており、AI出力には誤りが含まれる可能性があると説明しています。

医療AIはチャットボット段階を超え、EHR、音声入力、診療文書、請求業務を横断する実装フェーズへ進みつつあることを示す事例といえるでしょう。

参考:AWS公式ブログ

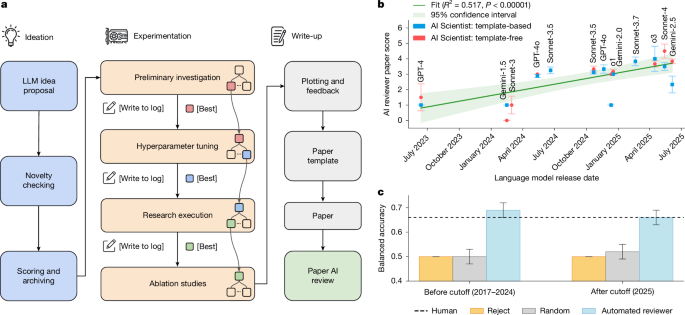

The AI Scientistが示した“自律型研究エージェント”の到達点

Natureに掲載された研究では、Sakana AI、UBC、Vector Institute、Oxford大学などの研究チームが、研究プロセス全体を自動化するシステム「The AI Scientist」を報告しました。

本システムは、研究アイデアの生成から、文献検索、実験計画、コード作成、実験実行、データ解析、図表作成、論文執筆、さらには自動査読までを一連のパイプラインとして実行します。

研究チームは、The AI Scientistが生成した論文を、ICLR関連ワークショップへ実際に投稿しています。 その結果、1本は採択基準を超える評価を得たと報告されました。

ただし、事前プロトコルに従い論文は取り下げられており、正式採択には至っていません。

これは、AIが研究補助を超え、「研究者に近い役割」を担い始めていることを示す象徴的な事例といえます。

一方で、現段階では限界も明確です。

生成される研究には、浅いアイデア、不正確な引用、実装ミスなどが含まれる可能性があります。

また、大量のAI生成論文が査読システムへ負荷を与える懸念や、研究責任・透明性・著者性をどのように定義するかという倫理的課題も指摘されています。

医療研究分野でも、今後はAIを「自律的研究支援者」としてどう位置づけるかが議論されていく可能性があります。

参考:Nature論文

医療AIにおけるサイバーセキュリティ提言

HAIPとHealth ISAC Japanは、医療分野における生成AI活用について、サイバーセキュリティ提言を公表しました。

診療録作成や文書要約などで生成AI導入が進む一方、新しいリスクへの対応が求められています。

生成AIでは、プロンプトインジェクション、RAGポイズニング、クラウド障害、API停止など、従来型システムとは異なる脅威が存在します。

そのため、単発のPoCや部門単位導入ではなく、経営層を含めた全体最適型ガバナンスの整備が必要とされています。

また、医療機関ごとのセキュリティ格差を防ぐため、共通基準、監査体制、共同プラットフォーム構築の必要性も提言されています。

医療AIの普及が進むほど、技術力だけでなく、安全運用体制そのものが競争力になる時代へ入りつつあるといえるでしょう。

参考:HAIP共同提言PDF

Anthropic、SpaceXと計算資源利用で提携

Anthropicは2026年5月、SpaceXとの計算資源利用契約を発表しました。

今回の契約により、Anthropicはテネシー州メンフィスにある「Colossus 1」データセンターの計算能力へアクセスし、22万基超のNVIDIA GPUに相当する大規模インフラを利用可能になると説明しています。

AnthropicはすでにAmazon、Google/Broadcom、Microsoft/NVIDIA、Fluidstackなどとも大規模インフラ契約を進めていますが、今回SpaceXが加わったことで、急増するClaude利用需要への対応をさらに強化する狙いがあると考えられます。

また、将来的には複数GW規模の軌道上AI計算基盤構想にも関心を示しており、AIインフラ競争が地上データセンターを超えた段階へ進み始めている点も注目されます。

現在の生成AI競争では、モデル性能だけでなく、GPU、電力、冷却、データセンター、ネットワークといった基盤確保が極めて重要になっています。

医療AIにおいても、モデルそのものだけでなく、可用性、運用継続性、計算資源供給体制を含めた「インフラの安定性」が重要な評価軸になりつつあります。

Claude Codeの利用制限が緩和

Anthropicは、SpaceXとの計算資源提携にあわせて、Claude CodeおよびClaude APIの利用制限を大幅に緩和すると発表しました。

Pro、Max、Team、Enterpriseプランでは5時間あたりの利用可能量が拡大され、一部プランではピーク時間帯の制限も撤廃されます。

Claude Codeは、AIによるコーディング支援ツールとして急速に普及していますが、利用者の増加に伴い、ピーク時間帯のレートリミットが実務上の課題になっていました。

今回の緩和は、実運用レベルでAI開発支援ツールを利用するユーザーの増加を反映した動きといえます。

背景には、生成AI市場における「計算資源競争」の激化があります。

現在はモデル性能だけでなく、GPU供給、データセンター容量、電力確保がサービス品質を左右しています。

医療領域でも、AIを安定運用するためには、性能評価だけでなく、サービス継続性や障害耐性、インフラ依存性まで含めた視点が必要になると考えられます。

医師を狙うAIディープフェイク問題が深刻化

米国医師会(AMA)は、医師を装うAIディープフェイクについて、「単なる詐欺ではなく、公衆衛生上の脅威」であるとして法整備を求めました。

近年は、医師の顔や声を悪用し、偽の医療広告や健康商材を宣伝するケースが急増しています。

カリフォルニア州では、AIが医療資格者であるかのように表示されることを規制する法案が成立しており、AI生成コンテンツを利用した健康関連広告への開示義務も議論されています。

また、精神科医を名乗るチャットボットが医師免許番号を提示した事例では、州政府による提訴も行われました。

CNNのSanjay Gupta医師も、自身を模倣したディープフェイク動画被害を報告しています。

本人を知る人でも騙されるほど精巧化しているとされ、医療情報の信頼性が大きく揺らぐリスクが指摘されています。

今後は、本人認証、AI生成表示、迅速な削除対応など、多層的な対策が求められると考えられます。

Hermes AgentがOpenRouterランキング首位に

オープンソースAIエージェント領域では、Nous Researchの「Hermes Agent」が、OpenRouterランキングでOpenClawを上回ったことが話題となりました。

今回の動きは、AIエージェント市場が単一方向ではなく、異なる設計思想へ分岐し始めていることを示しています。

OpenClawは、多数のメッセージングサービスや外部ツールとの接続性を強みとし、「到達範囲の広さ」を重視した構成を特徴としています。

一方、Hermes Agentは「self-improving AI agent」として、過去の会話や経験をもとにスキルを改善し、利用者ごとのワークフローへ適応する学習型アプローチを打ち出しています。

また、両者ともセキュリティ面での課題が注目されています。

OpenClawでは複数の脆弱性が報告され、Hermes Agent側でも大規模な修正が実施されました。

医療現場でAIエージェントを導入する場合、利便性だけでなく、権限管理、監査ログ、外部スキルの信頼性、実行環境の隔離などを含めた包括的な評価が必要になります。

OpenAI、Realtime API向け新音声モデルを発表

OpenAIは2026年5月7日、Realtime API向けの新たな音声モデル群「GPT-Realtime-2」「GPT-Realtime-Translate」「GPT-Realtime-Whisper」を発表しました。

今回のアップデートでは、音声AIが単なる会話インターフェースから、推論、翻訳、文字起こし、ツール操作までをリアルタイムで行う「行動型インターフェース」へ進化しつつある点が注目されています。

GPT-Realtime-2は、自然な対話を維持しながら複雑な依頼を処理し、複数ツールの呼び出しや割り込みへの対応も可能とされています。

GPT-Realtime-Translateは70以上の入力言語に対応し、専門用語や文脈を保持したままライブ翻訳を実施します。

さらにGPT-Realtime-Whisperは低遅延ストリーミング文字起こしを実現し、リアルタイム字幕や会議記録などへの応用が期待されています。

医療領域では、問診支援、診療補助、患者説明、多言語診療、遠隔医療、会議記録などへの展開が想定されます。

一方で、録音データの保管、誤認識時の責任範囲、AIが実行可能な操作権限の設計など、実装時のガバナンス整備が不可欠になると考えられます。

参考:OpenAI公式記事

今週のまとめ

今週の医療AI関連ニュースでは、生成AIが「チャットツール」から、医療・研究・創薬の実業務へ統合され始めている流れがより明確になりました。

音声AI、EHR統合型AI、創薬支援、自律型研究エージェントなど、AIが業務プロセスそのものを支援する事例が増えています。

一方で、AIディープフェイク、セキュリティ脆弱性、誤情報、研究責任といった課題も同時に拡大しています。

特に医療分野では、AIの誤作動や不適切な出力が患者安全や医療の信頼性に直結するため、性能だけでなく、ガバナンスや運用体制の整備が重要になります。

また、AnthropicとSpaceXの提携に象徴されるように、生成AI競争はモデル性能だけでなく、GPU、電力、データセンターなど「計算資源」の競争へ進みつつあります。

今後の医療AI活用では、「どのAIを使うか」だけでなく、「どのように安全かつ継続的に運用するか」が重要なテーマになると考えられます。

本ページは、医療・AI・アフェレシス領域に関連する公開情報を紹介し、委員の見解を付した情報共有記事です。

リンク先の記事・画像・図表・本文等の著作権は各権利者に帰属します。

当サイトでは、リンク先コンテンツの転載は行っておりません。

掲載内容は公開時点の情報に基づくものであり、特定の医療行為、製品、企業、医療機関等を推奨するものではありません。

診療上の判断は、最新の公的情報・原著論文・添付文書・各施設の方針等をご確認のうえ、専門職の責任において行ってください。